Notizen

IHK Prüfung:

Technisch:

Gründe für ein VLAN

IEE108Q - WLAN Standard

IEE802.1 - Port Security

DHCP - Dora prinzip

Unterschied zwischen SFP und SFP+ und QFSP

Ne Routing Tabelle

Die VPN Typen

Fragen zu Zertifikaten

Warum funktioniert ein VPN nicht in einem Hotspot

Fragen zu DNS DNS-Sec, Sicherheitsfeatures

RTO und RPO

Sicherheitssstellung am Server zu verschiedenen Bereichen

Verschlüsselung

E-Mail angriffe verhindern

USV-Diemensonieren (Offline Online LineInterActive - USV)

Horizontale oder Diagonale Skalierung (Zusätzlich Hardware dazu packt)

Wertikale Skalierung is die einzelnen Nodes stärker ausstatten

Horizontal Skalieren is mehr nodes dazu packen

Blue Green Methode beim Skalieren, load balancing

(Erst ein komplettes enviroment Upgraden und schaltet das alte enviroment auf das neue enviroment)

Strukturierte Verkabelung

Programmierung: Agregation und Komposition

Backups rechnung für die Speicherkapazität nach Zeit (Raid)

Wirtschaft's Themen:

Betriebsrat

Tarifverträge

Lastenheft:

Das Lastenheft (auch Anforderungsspezifikation, Anforderungskatalog, Produktskizze, Kundenspezifikation oder Anwenderspezifikation) beschreibt die Gesamtheit der Anforderungen des Auftraggebers an die Lieferungen und Leistungen eines Auftragnehmers.

Die Anforderungen in einem Lastenheft sollten so allgemein wie möglich und so einschränkend wie nötig formuliert werden. Hierdurch hat der Auftragnehmer die Möglichkeit, eine passende Lösung (z. B. eine Software) zu erarbeiten, ohne in seiner Lösungskompetenz durch zu konkrete Anforderungen eingeschränkt zu sein.

Das Lastenheft kann der Auftraggeber in einer Ausschreibung verwenden und an mehrere mögliche Auftragnehmer verschicken. Diese erstellen jeweils ein Pflichtenheft, welches in konkreterer Form beschreibt, wie sie die Anforderungen im Lastenheft zu lösen gedenken. Der Auftraggeber wählt dann aus den Vorschlägen der möglichen Auftragnehmer den für ihn geeignetsten aus.

TOM's:

Technisch organisatorische Maßnahme (TOM) verfolgt das Ziel der präventiven Vorsorge.

Diese Vorsorge ist in zewi Klassen einzuteilen: eine, die die Technik und eine, die die Organisation betrifft.

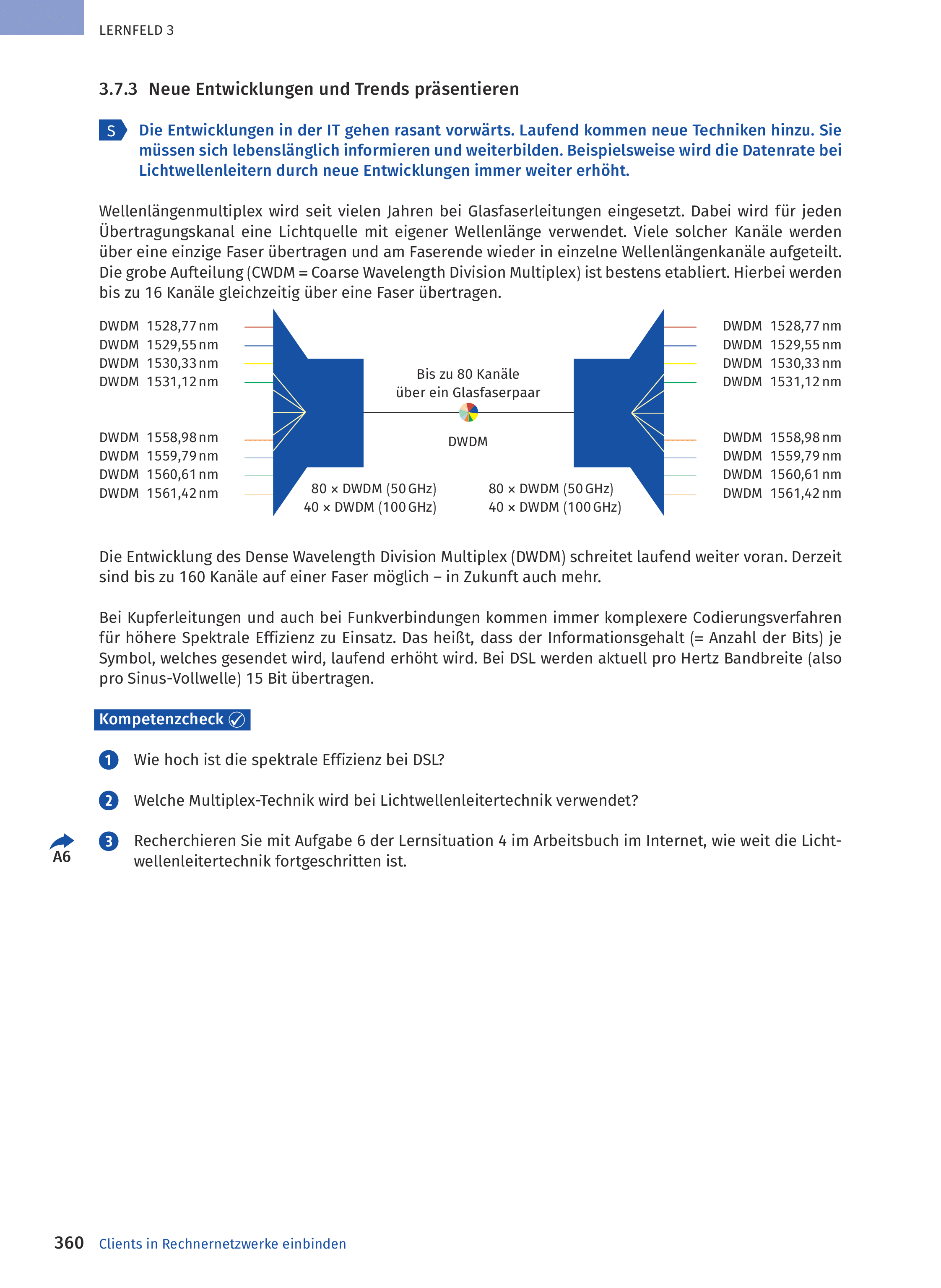

Glasfaser:

WLAN Technologien:

| Bezeichnungen | Sendefrequenz | Max. Datendurchsatz | Bemerkungen | |

| alt | neu | |||

| 802.11 | Wi-Fi 1 | 5 GHz | 2 Mbit/s | |

| 802.11b | Wi-Fi 2 | 2,4 GHz | 11 Mbit/s | |

| 802.11g | Wi-Fi 3 | 2,4 GHz | 54 Mbit/s | |

| 802.11n | Wi-Fi 4 | 2,4 GHz und 5 GHz | 72-600 Mbit/s | |

| 802.11ac | Wi-Fi 5 | 5 GHz | 433-6933 Mbit/s | |

| 802.11ad | Gigabit-WLAN | 60 GHz | Bis 6930 Mbit/s | Max. 10m Reichweite wegen der hohen Dämpfung der Sendefrequenz |

| 802.11ax | Wi-Fi 6 | Freie ISM-Bänder von1 bis 6 GHz | 600-9608 Mbit/s | |

| 802.11ay | Wi-Fi 6E | Wie Wi-Fi 6 | 600-9608 Mbit/s | Zusätzliche Kanäle bei 6 GHz |

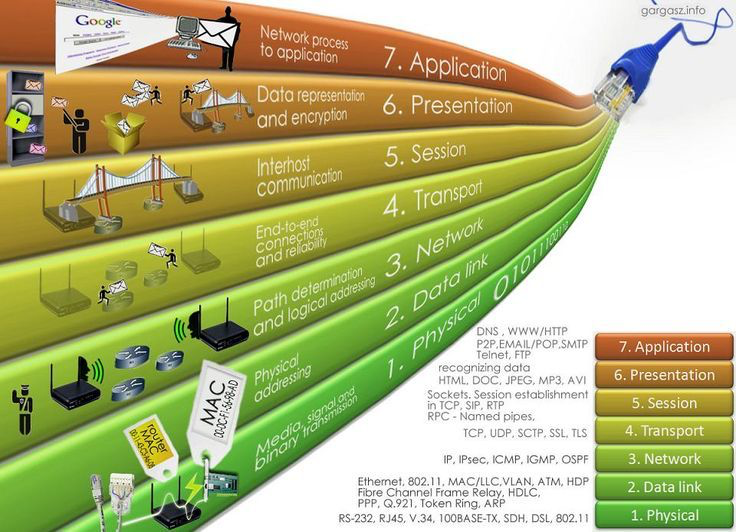

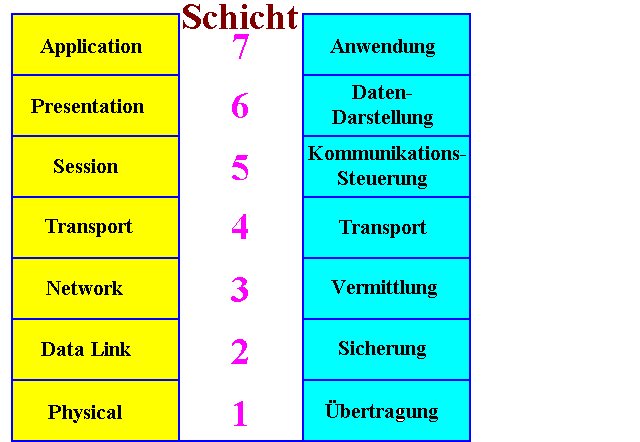

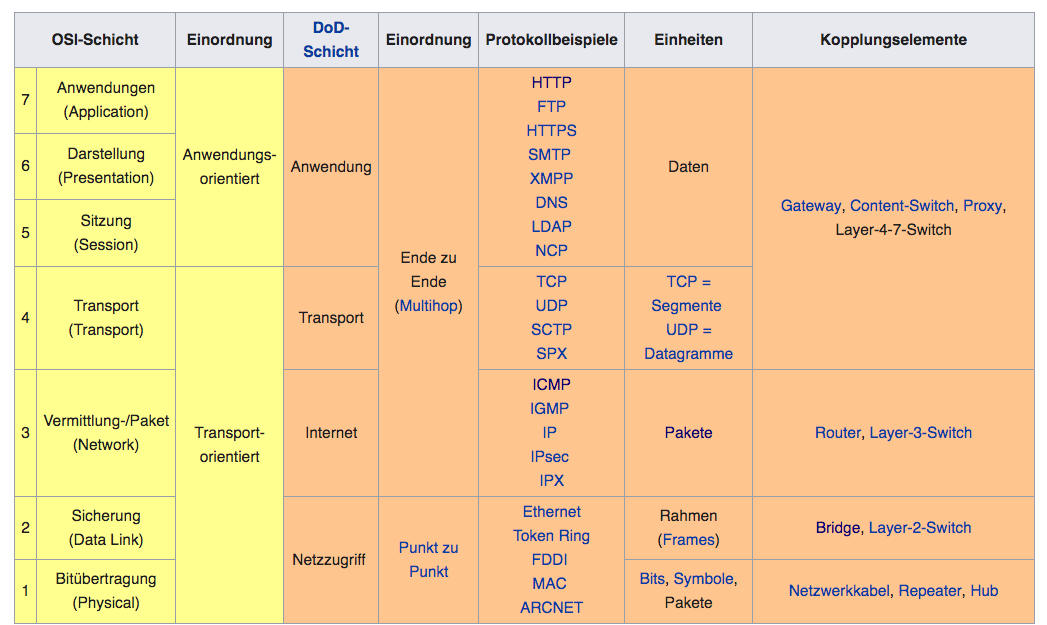

OSI Schicht Modell:

| Schichten - Englisch | Schichten Deutsch | Einordnung | DoD Schicht | Protokollbeispiele | |

| 7. Application | 7. Anwendung | Anwendungsorientiert | Anwendung | HTTP, FTP, HTTPS, SMTP, XMPP, DNS, LDAP, NCP | Stellt sicher das man mit den Daten arbeiten kann, stellt Verbindung zu den unteren Schichten da |

| 6. Presentation | 6. Darstellung | Anwendungsorientiert | Anwendung | HTTP, FTP, HTTPS, SMTP, XMPP, DNS, LDAP, NCP |

Übersetzer und Darstellt das wir damit etwas anfangen können |

| 5. Session | 5. Sitzung | Anwendungsorientiert | Anwendung | HTTP, FTP, HTTPS, SMTP, XMPP, DNS, LDAP, NCP |

Verbindung aufrecht erhalten, bei Fehlern muss nicht komplett von vorne begonnen werden |

| 4. Transport | 4. Transport | Transportorientiert | Transport | TCP, UDP, SCTP, SPX | Werden für den Versand vorbereitet, Daten werden in Pakete gepackt |

| 3. Network | 3. Vermittlung- / Paket | Transportorientiert | Internet | ICMP, IGMP, IP, IPsec, IPX | Logistic der Übertragung |

| 2. Data Link | 2. Sicherung | Transportorientiert | Netzzugriff | Ethernet, Token Ring, FDDI, MAC, ARCNET | Übertragungsfehler erkennt sie |

| 1. Physical | 1. Bitübertragung | Transportorientiert | Netzzugriff | Ethernet, Token Ring, FDDI, MAC, ARCNET | Überträgt nur Bytes, Fehler werden nicht bemerkt |

ArchivBit:

SMT (Hyperthreading):

Verschlüsselung:

Allgemein versteht man unter Verschlüsselung ein Verfahren, das eine lesbare Information (Klartext) durch einen Schlüssel in einen Geheimtext (Chiffrat) umwandelt, so dass der Klartext nur unter Verwendung des Schlüssels wieder lesbar wird.

Symmetrische Verschlüsselung:

Bei der Symmetrischen Verschlüsselung wird ein und derselbe Schlüssel verwendet, um Botschaften zu verschlüsseln und auch wieder zu entschlüsseln.

Beispiel:

Möchte Bob eine verschlüsselte Liebesbotschaft an Alice schicken, muss er ihr vorher den geheimen Schlüssel übergeben. Die eifersüchtige Eve könnte die verschlüsselte Nachricht und den Schlüssel beim Übermitteln abfangen.

Noch dramatischer wird es, wenn wir uns vorstellen, dass Alice in einem Land lebt, wo die Behörden gerne Zugriff auf alle Daten hätten und es keinen „sicheren Hafen“ für Geheimnisse mehr gäbe. Das Abfangen von verschlüsselten Nachrichten und versendeten Schlüsseln ist ein Kinderspiel für solche Behörden.

Asymmetrische Verschlüsselung:

Bei der asymmetrischen Verschlüsselung gibt es zwei Schlüssel:

der Verschlüsselungs-Schlüssel und der Entschlüsselungs-Schlüssel, sind also nicht identisch.

Wenn Alice von Bob nur verschlüsselte Liebesbotschaften erhalten möchte, benötigt sie ein Schlüsselpaar bestehend aus einem Verschlüsselungs-und einem Entschlüsselungs-Schlüssel. Der Verschlüsselungs-Schlüssel (öffentlicher Schlüssel oder public key) ist jedem bekannt und muss keineswegs auf sicherem Weg übergeben werden.

Alice kann den öffentlichen Schlüssel auf ihrer Homepage veröffentlichen, so dass auch Eve Kenntnis hiervon erhalten kann. Der Entschlüsselungs-Schlüssel (privater Schlüssel oder private key) ist dagegen streng geheim. Nur Alice sollte diesen Entschlüsselungs-Schlüssel haben, denn nur mit diesem kann die Nachricht entschlüsselt werden. Bob verschlüsselt die Nachricht also mit dem öffentlichen Schlüssel und Alice entschlüsselt diese mit ihrem privaten Schlüssel. Auch wenn Eve im Besitz des öffentlichen Schlüssel ist und die verschlüsselte Nachricht abfängt, kann sie die Nachricht nicht lesen, da hierzu der private Schlüssel notwendig ist.

Hybride Verschlüsselung:

Nachteil der asymmetrischen Verschlüsselung ist, dass diese langsamer ist als die symmetrische.

Um beide Vorteile zu verbinden: die Schnelligkeit der symmetrischen und die Sicherheit der asymmetrischen Verschlüsselung hat man die hybride Verschlüsselung entwickelt.

Dabei wird ein symmetrischer Schlüssel (Session-Key) erstellt, mit dem die zu schützenden Daten symmetrisch verschlüsselt werden.

Anschließend wird der Session-Key asymmetrisch mit dem öffentlichen Schlüssel des Empfängers verschlüsselt und dem Empfänger übermittelt.

Grenzen der Verschlüsselung:

Eine Verschlüsselung alleine bringt nichts, wenn weitere Faktoren nicht beachtet werden:

- Die Schlüssellänge muss so gewählt sein, dass die Verschlüsselung nicht sofort geknackt wird. Je größer die Sicherheitsanforderung ist, desto mehr Bits sollen gewählt werden. Da der Wert N=201 373 als öffentlicher Schlüssel bekannt ist, kann Eve durch Probieren schnell auf die Werte p=349 und q=577 kommen. Deswegen muss N groß genug sein.

- Verschlüsselung muss auf dem neusten Stand der Technik sein. Auch wenn man heute eine „sichere“ Verschlüsselung wählt, kann diese in ein paar Jahren/Jahrzehnten nicht mehr brauchbar sein. Derzeit wird an großen Hochschulen und Firmen in den USA an einem Quantenrechner gearbeitet, der irgendwann alle derzeit gängigen Verschlüsselungsverfahren knacken soll. Gesponsert wird diese „Forschung“ durch die NSA.

- Bei der Inhaltsverschlüsselung von z.B. E-Mails ist zu beachten, dass zwar der Inhalt und eventuell die Anhänge verschlüsselt werden, aber beispielsweise nicht der Betreff, Empfänger oder Absender („Metadaten“). Deswegen sollte auch zusätzlich der Kommunikationsweg verschlüsselt werden und nicht nur der Inhalt.

- Bei der asymmetrischen Verschlüsselung muss der private Schlüssel geheim bleiben. Liegen z.B. personenbezogene Daten in einem Rechenzentrum nützt die beste Verschlüsselung nichts, wenn auch das Rechenzentrum im Besitz des Enschlüsselungs-Schlüssels ist.

- Wird für die Verschlüsselung ein Passwort benutzt, muss ein Passwort gewählt werden, dass den Sicherheitsanforderungen entspricht.

Verschlüsselungsalgorithmen:

(Welche Verschlüsselungsalgorithmen werden am häufigsten benutzt und welche sind veraltet? (DES [Digital Encryption Standard], Triple-DES, AES [Advanced Encryption Standard], Blowfish, RSA-OAEP, Diffie-Hellmann, MD5))

DES - Veraltet :

Bei DES handelt es sich um ein symmetrisches Verschlüsselungsverfahren, das in den 1970er Jahren von IBM entwickelt und 1977 durch das US-amerikanische National Institute of Standards and Technology (NIST) standardisiert wurde.

Der Standard ist frei von Patentrechten, gilt aufgrund der geringen Schlüssellänge von 64 bit (effektiv nur 56 bit) heute jedoch als veraltet.

Bereits 1994 wurde das Kryptosystem mit zwölf HP-9735-Workstations und einem Rechenaufwand von 50 Tagen geknackt. Mit dem heutigen Stand der Technik lässt sich ein DES-Schlüssel durch Brute-Force-Angriffe bereits in wenigen Stunden entziffern.

Ein Hauptkritikpunkt an DES ist die geringe Schlüssellänge von 56 bit, die in einem vergleichsweise kleinen Schlüsselraum resultiert. Dieser kann Brute-Force-Angriffen mit der heute zur Verfügung stehenden Rechenleistung nicht mehr standhalten. Zudem wird das Verfahren der Schlüsselpermutation, das 16 nahezu identische Rundenschlüssel erzeugt, als zu schwach eingeschätzt.

Triple-DES (3DES) - Veraltet :

Mit Triple-DES (3DES) wurde eine Variante von DES entwickelt, bei der das Verschlüsselungsverfahren in drei aufeinanderfolgenden Runden durchlaufen wird. Doch auch die effektive Schlüssellänge von 3DES beträgt effektiv lediglich 112 bit und liegt damit noch immer unter dem heutigen Mindeststandard von 128 bit. Zudem ist 3DES deutlich rechenintensiver als DES.

Der Data Encryption Standard wurde daher weitgehend ersetzt. Als Nachfolger gilt der ebenfalls symmetrische Verschlüsselungsalgorithmus Advanced Encryption Standard.

Advanced Encryption Standard (AES) - Modern :

AES ein Verfahren, das sich aufgrund seiner Sicherheit, Flexibilität und Performance in einer öffentlichen Ausschreibung durchsetzte und Ende 2000 vom NIST als Advanced Encryption Standard (AES) zertifiziert wurde.

Der Advanced Encryption Standard (AES) ist ein symmetrischer Verschlüsselungsalgorithmus, der feste Datenblöcke von 128 Bit verschlüsselt. Die zum Entschlüsseln verwendeten Schlüssel können 128, 192 oder 256 Bit lang sein. Der 256-Bit-Schlüssel verschlüsselt die Daten in 14 Runden, der 192-Bit-Schlüssel in 12 Runden und der 128-Bit-Schlüssel in 10 Runden. Jede Runde besteht aus mehreren Schritten von Substitution, Austausch, Verwischung der Beziehung zwischen Klar- und Geheimtext und mehr. AES-Verschlüsselungsstandards sind die heutzutage am häufigsten verwendeten Verschlüsselungsmethoden, sowohl für gespeicherte Daten als auch bei der Datenübertragung.

Rivest-Shamir-Adleman (RSA) - Modern :

RSA (Rivest-Shamir-Adleman) ist ein asymmetrisches kryptographisches Verfahren, das auf der Faktorisierung des Produkts zweier großer Primzahlen basiert. Nur Personen, die diese Zahlen kennen, können die Nachricht erfolgreich entschlüsseln. RSA wird oft verwendet, wenn Daten zwischen zwei separaten Endpunkten (zum Beispiel bei Webverbindungen) übertragen werden, funktioniert jedoch langsam, wenn große Datenmengen verschlüsselt werden müssen.

Triple-DES (Data Encryption Standard) - Modern :

Triple-DES ist ein symmetrisches Verschlüsselungsverfahren und eine erweiterte Form der DES-Methode, die Datenblöcke mit einem 56-Bit-Schlüssel verschlüsselt. Triple-DES wendet den DES-Verschlüsselungsalgorithmus dreimal auf jeden Datenblock an. Üblicherweise wird Triple-DES zum Verschlüsseln von Geldautomaten-PINs und UNIX-Passwörtern genutzt.

Twofish - Modern :

Twofish ist ein lizenzfreies Verschlüsselungsverfahren, das Datenblöcke von 128 Bit chiffriert. Es gilt als Nachfolger des 64-Bit-Verschlüsselungsverfahrens Blowfish und ist vielseitiger als sein spezialisierter Nachfolger Threefish. Twofish verschlüsselt die Daten unabhängig von der Schlüsselgröße immer in 16 Runden. Auch wenn sie langsamer ist als AES, wird die Twofish-Verschlüsselungsmethode noch immer von einigen Softwarelösungen zur Verschlüsselung von Dateien und Ordnern verwendet.

Einsatzszenarien aus der Praxis:

S/MIME:

Secure/Multipurpose Internet Mail Extensions (kurz: S/MIME) ist ein Standardverfahren zum Verschlüsseln und Signieren von E-Mails, das vor allem bei Unternehmen zum Einsatz kommt. Firmen können damit sowohl die Integrität der übertragenen Informationen als auch die Identität des Absenders sicherstellen. S/MIME nutzt eine hybride Verschlüsselung, bei dem die Inhalte der E-Mail durch eine symmetrische Verschlüsselung geschützt sind, während der Schlüsselaustausch über ein asymmetrisches Verfahren verfolgt. S/MIME setzt außerdem auf ein hierarchisches Zertifikatssystem zur Authentifizierung der Public Keys. Unternehmen und private Nutzer erhalten hierzu von zentralen Zertifizierungsstellen (Certificate Authority) die für die Schlüsselerstellung benötigten Zertifikate. Je nach Authentifizierungsgrad sind unterschiedliche Klassen an Zertifikaten erhältlich, manche Zertifizierungsstellen bieten auch kostenlose Zertifikate für den privaten Einsatz an.

PGP:

Das von Phil Zimmermann entwickelte Tool Pretty Good Privacy (kurz: PGP) dient ebenfalls zur Verschlüsselung und Signatur von E-Mails. Es verfolgt einen ähnlichen Ansatz wie S/MIME, wird im Gegensatz dazu aber primär für den Privatgebrauch eingesetzt. Im Gegensatz zu S/MIME „zertifizieren“ bei PGP vertrauenswürdige Dritte die erforderlichen Schlüssel – zentrale Stellen gibt es im sogenannten Web of Trust, das sich aus den PGP-Nutzern zusammensetzt, nicht. Aus diesem Grund wird PGP oder dessen freie Forks OpenPGP und GnuPG auch von der Open-Source-Gemeinschaft bevorzugt für die Absicherung von E-Mails behandelt.

Wofür steht PGP / OpenPGP?

PGP bedeutet Pretty Good Privacy, also auf Deutsch etwa Ziemlich gute Privatsphäre. PGP bezeichnet heute allerdings nur noch ein Programm, das noch als „Symantec Encryption Desktop“ zu beziehen ist. Alternativ wurde der freie Standard OpenPGP entwickelt, der in GPG zum Einsatz kommt. PGP ist entsprechend nur noch umgangssprachlich.

KeePass:

Der freie Passwortmanager KeePass dient der lokalen Verwaltung von Logindaten auf Desktop-Systemen. Zur Absicherung der Kennwortdatenbank nutzt die Open-Source-Lösung symmetrische Verschlüsselungsverfahren. Je nach eingesetzter KeePass-Version und Nutzervorlieben kommen hierfür die Algorithmen AES, Twofish oder ChaCha20 zum Einsatz. Die verschlüsselte Datenbank lässt sich nur durch die Eingabe des zuvor festgelegten Masterpassworts wieder frei sperren. KeePass ist primär für die Nutzung unter Windows konzipiert, weitere Betriebssysteme decken die zahlreichen Forks des Projekts ab, wie etwa KeePassXC, Keepass2Android oder MiniKeePass.

HTTPS:

Das HTTPS-Protokoll (Hypertext Transfer Protocol Secure) erlaubt den Aufbau von verschlüsselten Verbindungen im Internet. Technisch handelt es sich bei HTTPS um herkömmliche Verbindungen mittels HTTP (Hypertext Transfer Protocol) in Kombination mit Verschlüsselung und Authentifizierung via SSL/TLS (Secure Sockets Layer / Transport Layer Security). SSL und dessen Nachfolger TLS sichern als kryptografische Zusatzschicht den Datenverkehr im Netz. In der Praxis kommt heutzutage nahezu ausschließlich TLS zum Einsatz. Dennoch hat sich im Sprachgebrauch die Verschlüsselungsmethode mit der Bezeichnung “SSL/TLS” eingebürgert. TLS benutzt ein asymmetrisches Verfahren für den Schlüsselaustausch. Die verschlüsselte Verbindung selbst verwendet hingegen ein symmetrisches Verfahren, um Performance-Einbußen zu vermeiden. Für die eindeutige Authentifizierung von Servern und Domains sind SSL-Zertifikate erforderlich, die Seitenbetreiber bei Zertifizierungsstellen erhalten.

Datensicherung:

Vollsicherung:

Im Rahmen einer Volldatensicherung oder Komplettsicherung werden alle Daten jedes Mal komplett auf das Backup-Medium übertragen. Der Vorteil einer Vollsicherung besteht in der einfachen Durchführung. Allerdings sind Vollsicherungen vergleichsweise ressourcenintensiv.

Ein Beispiel: Ihre IT sichert jeden Tag alle Unternehmensdaten. Das vereinfacht die Organisation, weil nicht zuerst bestimmte Datensätze ausgewählt werden müssen. Jedoch wird auf diese Weise sehr viel Speicherplatz mit den immer gleichen Daten gebunden, die sich wahrscheinlich in der Zwischenzeit nur wenig verändert haben.

Auch der Zeitfaktor kann sich negativ bemerkbar machen. Unternehmen verfügen nicht selten über Datenmengen, die sich im Petabyte-Bereich bewegen. Selbst wenn ein modernes Bandlaufwerk 1 Terabyte pro Stunde sichert, würde das Backup für 1 Petabyte noch 1024 Stunden dauern.

Deshalb werden meist mehrere Bandlaufwerke parallel betrieben, wodurch sich die Backup-Zeit deutlich reduzieren lässt. Aber selbst dann gilt: In der Zeit, in der das Backup läuft, verlangsamt sich die Arbeitsgeschwindigkeit aller Rechner und Server im Netzwerk.

Aus den genannten Gründen bieten sich fortlaufende Vollbackups nur für Szenarien mit überschaubaren Datenmengen an, beispielsweise in Entwicklungsumgebungen oder bei Datenbanken. Vollbackups bilden aber auch die Grundlage für die beiden anderen wichtigen Sicherungsarten, das differenzielle und das inkrementelle Backup.

Differenziellen Sicherung:

Für ein differenzielles Backup wird zu Beginn eine Datensicherungsstrategie und ein Vollbackup aller Daten durchgeführt. Bei jedem weiteren Sicherungsdurchgang werden allerdings nur die Daten gesichert, die sich in der Zwischenzeit verändert haben oder neu hinzugekommen sind. Die differenzielle Datensicherung erfasst also nur die Differenz zwischen dem Status quo und dem letzten Komplett-Backup.

Das hat mehrere Vorteile. Es wird weniger Speicherplatz benötigt, um ein neues Backup anzufertigen. Der Backup-Vorgang kann wesentlich schneller abgewickelt werden, Ihre User können umgehend wieder die gewohnte Arbeitsgeschwindigkeit nutzen. Und nicht zuletzt können die unterschiedlichen Sicherungsversionen unabhängig voneinander gelöscht werden. Sobald das heutige differenzielle Backup erstellt wurde, entfernen Sie einfach das gestrige. Das hält Ihr Backup-System schlank.

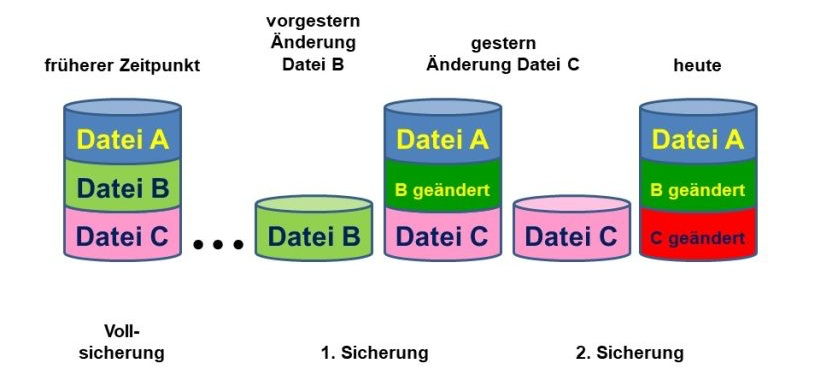

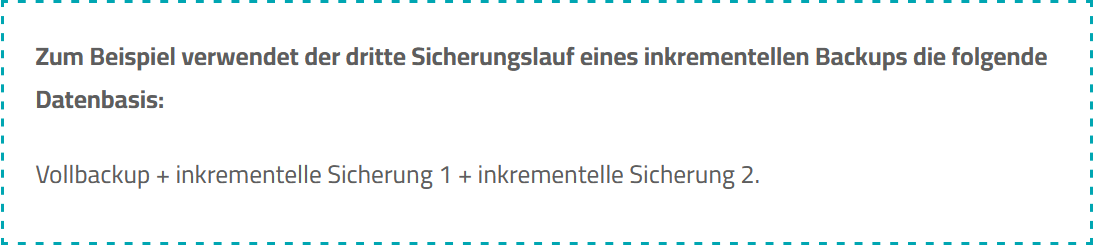

Inkrementellen Sicherung:

Auch beim inkrementellen Backup werden auf Basis eines Vollbackups die neu hinzugekommenen Daten gesichert. Allerdings baut das inkrementelle Backup immer auf dem zuletzt erstellten Sicherungslauf auf (inkrementell = schrittweise, aufeinander aufbauend). Das heißt, es werden das Vollbackup plus alle zwischenzeitlich erstellten inkrementellen Sicherungsläufe zugrunde gelegt.

Der große Vorteil der inkrementellen Datensicherung besteht im sehr geringen Speicherbedarf. Der Nachteil ist, dass bei einer Wiederherstellung die Daten aus mehreren Sicherungsläufen in der richtigen Reihenfolge zusammengefügt werden müssen. Das verkompliziert den Wiederherstellungsvorgang im Vergleich zum differenziellen Backup, das mit nur zwei Komponenten auskommt.

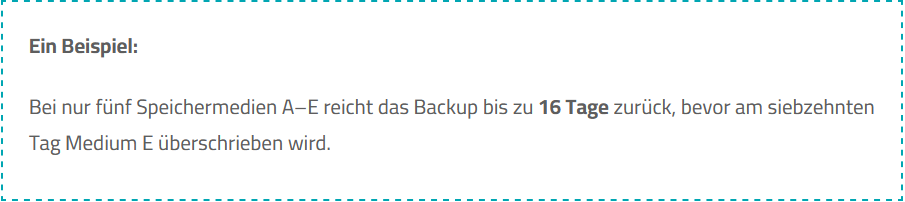

Backup Strategie:

First In First Out (FIFO)

Der simpelste Ansatz: Neigt sich der Speicherplatz des Backup-Mediums dem Ende zu, wird die älteste Backup-Version gelöscht und durch eine neue ersetzt. Dieses Prinzip funktioniert gut für Vollbackups und differenzielle Sicherungsläufe.

Das Großvater-Vater-Sohn-Prinzip

Diese Methode wird auch als Generationenprinzip bezeichnet. Das Sohn-Backup wird am Ende jedes Werktags erstellt, das Vater-Backup am Ende der Woche, das Großvater-Backup am Ende des Monats.

Das Prinzip wird hier am Beispiel eines Vollbackups erklärt, es lässt sich aber auch auf differenzielle und inkrementelle Datensicherungen anwenden. Sie benötigen insgesamt 20 Speichermedien, beispielsweise Sicherungsbänder. Vier Bänder verwenden Sie für die ersten vier Wochentage. Am fünften Wochentag, also am Freitag, erstellen Sie das wöchentliche Backup. Dafür benötigen Sie ebenfalls vier Bänder, für die vier Wochen des Monats. Hinzu kommen weitere zwölf Backup-Medien, für alle Monats-Backups des Jahres.

Das Großvater-Vater-Sohn-Prinzip stellt sicher, dass jederzeit Backups verschiedenen Alters verfügbar sind. Auf diese Weise können Sie leicht auf vorhergehende Versionen Ihrer Daten zugreifen. Ein weiterer Vorteil: Sollte ein Backup-Medium einmal beschädigt sein, haben Sie durch die Vielzahl der Medien immer eine Ersatzsicherung zur Hand.

Die Türme von Hanoi

Diese Methode zur Organisation von Backups beruht auf dem gleichnamigen Knobelspiel Die Türme von Hanoi. Die Scheiben der Türme entsprechen den Sicherungsmedien. Bei jeder Bewegung einer Scheibe wird ein Backup auf das entsprechende Medium aufgespielt. Auf diese Weise erreichen Sie einen guten Kompromiss zwischen den verfügbaren Speichermedien und dem Alter der vorgehaltenen Backups.

Diese Vorgehensweise erlaubt es Ihnen, mit weniger Speichermedien als beim Großvater-Vater-Sohn-Prinzip zu operieren, aber trotzdem auf ältere Versionen Ihrer Daten zuzugreifen.

Vor- und Nachteile verschiedener Speichermedien:

Es gibt unterschiedliche Sicherungsmedien, die bei Backups zum Einsatz kommen, mit spezifischen Vor- und Nachteilen.

Tape

Bandlaufwerke sind in Unternehmen immer noch weit verbreitet. Die dazugehörigen Magnetbänder können Datenmengen in der Größenordnung von vielen Terabytes aufnehmen. Sie sind vergleichsweise günstig in der Anschaffung. Allerdings sind sie auch verschleißanfällig. Und der Zugriff auf die gespeicherten Daten gestaltet sich komplizierter als beispielsweise bei externen Festplatten.

Festplatte

In vielen kleineren Unternehmen kommen mittlerweile externe Festplatten für die Datensicherung zum Einsatz. Diese sind sehr kompakt und damit leicht zu transportieren und zu lagern. Außerdem haben Sie jederzeit schnell Zugriff auf Ihre Daten. Im Vergleich zu SSD-Laufwerken hinken externe Festplatten jedoch in Sachen Speicherplatz und Zugriffsgeschwindigkeit hinterher.

SSD

SSD-Laufwerke zur Datensicherung sind noch ein relativ junges Backup-Medium. Sie zeichnen sich durch hohe Speicherkapazitäten von bis zu 100 Terabyte aus und sind weniger erschütterungsanfällig als die klassische HDD. Ein flächendeckender Einsatz scheitert in vielen Unternehmen jedoch noch am hohen Preis der SSD-Medien.

Cloud

Es spricht sehr viel dafür, dass die Cloud das Backup-Medium der Zukunft wird. Bereits heute haben fast 80 Prozent aller deutschen Unternehmen Cloud-Lösungen im Einsatz. Die Gründe dafür sind vielfältig. Die Cloud bietet praktisch unbegrenzte Speicherkapazitäten, insbesondere im Fall der Public Cloud. Die Abrechnung erfolgt nutzungsabhängig. Dadurch, dass Ihre Daten auf externen Servern lagern, sind sie sehr gut vor lokalen Bedrohungen wie Brand oder Vandalismus geschützt.

Manche Unternehmen zögern noch, den Schritt in die Cloud zu machen, weil sie Sicherheitsbedenken haben. Hier kann eine Private Cloud Abhilfe bieten. Die Private-Cloud-Server sind nicht über öffentliche Internetverbindungen zugänglich und deshalb besser vor Hackerangriffen geschützt. Die benötigte Serverlandschaft kann entweder On-Premises untergebracht werden oder Off-Premises im Rechenzentrum eines Managed Services Providers.

IT-Austattung:

Was versteht man unter OpenSource?

Was versteht man unter GNU/GPL?

Was versteht man unter Public Domain?

Was versteht man unter OEM?

Was versteht man unter EULA?

Vor und Nachteile von parallelen oder seriellen Datenübertragungs Schnittstellen?

Video-Schnittstellen

VGA:

VGA-Anschluss (englisch: Video Graphics Array), ist eine analoge Übertragung von Bewegbildern zwischen Grafikkarten und Anzeigegeräten.

Die Einführung erfolgte 1987 und der VGA Anschluss kann bis 2560 x 1440 Pixel anzeigen, also Quad HD (QHD).

VGA - Spezifikation:

| Funktionalität | VGA |

|

VGA 640 x 480 |

✅ |

|

SVGA 800 x 600 |

✅ |

|

XGA 1024 x 768 |

✅ |

|

720p HD 1280 x 720 |

✅ |

|

1080p Full HD 1920 x 1080 |

✅ |

|

SXGA 1920 x 1200 |

✅ |

|

WUXGA 1920 x 1200 |

✅ |

|

2K (Quad HD) 2560 x 1440 |

✅ |

|

4K (Ultra HD) 3840 x 2160 |

❌ |

|

5K 5120 x 2880 |

❌ |

|

8K 7680 x 4320 |

❌ |

|

10K 10240 x 4320 |

❌ |

|

12K 11520 x 6480 |

❌ |

|

|

|

| Sound | ❌ |

DVI:

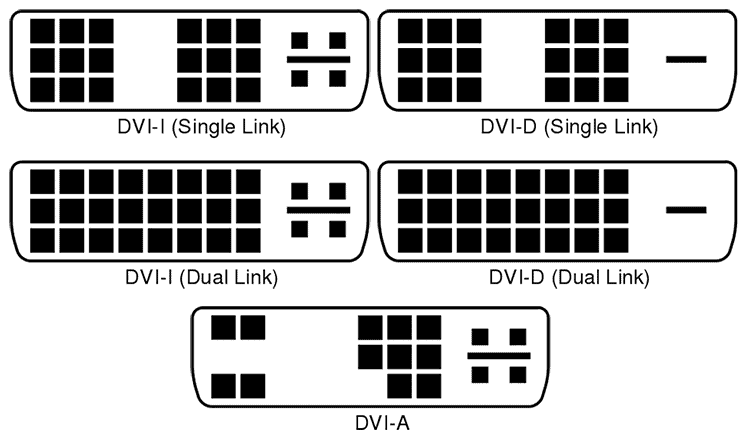

Im Grunde gibt es drei verschiedene Arten von DVI-Eingängen:

- DVI-D (nur digitales Signal)

- DVI-I (integriert, sowohl analoge als auch digitale Signale)

- DVI-A (nur analoges Signal)

DVI-D und auch DVI-I sind weit verbreitet, nur DVI-A wird sehr selten verwendet.

Darüber hinaus gibt es noch zwei Versionen von DVI-D und DVI-I, eine Single-Link und eine Dual-Link Version.

Jeder Verbindungstyp hat eine maximal zulässige Datenrate, die sicherstellt, dass die Daten bei der Übertragung von der Grafikkarte zum Monitor nicht verloren gehen.

Keine der DVI-Typen können Audio übertragen!

Die offizielle DVI-Spezifikation schreibt vor, dass alle DVI-Geräte ein Signal bis zu einer Länge von 5 Metern aufrechterhalten müssen.

Viele Hersteller bringen jedoch viel stärkere Karten und größere Monitore auf den Mart, sodass die maximal mögliche Länge nicht genau bekannt ist.

Verschiedene Typen:

- DVI-A

- DVI-D (Single Link)

- DVI-D (Dual Link)

- DVI-I (Single Link)

- DVI-I (Dual Link)

| DVI-Variante | Analog / Digital | Maximale Auflösung | Übertragungsrate |

| DVI-A | Analog | 1920 x 1200 (60 Hz) | nicht anwendbar, da nur analog |

| DVI-D (Single Link) | Digital | 1920 x 1200 (60 Hz) | 3,96 Gbit/s |

| DVI-D (Dual Link) | Digital | 2560 x 1600 (60 Hz) | 7,92 Gbit/s |

| DVI-I (Single Link) | Analog und Digital | 1920 x 1200 (60 Hz) | 3,96 Gbit/s |

| DVI-I (Dual Link) | Analog und Digital | 2560 x 1600 (60 Hz) | 7,92 Gbit/s |

DVI - Spezifikation:

| Funktionalität | DVI-A | DVI-D (Single Link) |

DVI-D (Dual Link) |

DVI-I (Single Link) |

DVI-I (Dual Link) |

|

VGA 640 x 480 |

✅ | ✅ | ✅ | ✅ | ✅ |

|

SVGA 800 x 600 |

✅ | ✅ | ✅ | ✅ | ✅ |

|

XGA 1024 x 768 |

✅ | ✅ | ✅ | ✅ | ✅ |

|

720p HD 1280 x 720 |

✅ | ✅ | ✅ | ✅ | ✅ |

|

1080p Full HD 1920 x 1080 |

✅ | ✅ | ✅ | ✅ | ✅ |

|

SXGA 1920 x 1200 |

✅ | ✅ | ✅ | ✅ | ✅ |

|

WUXGA 1920 x 1200 |

✅ | ✅ | |||

|

2K (Quad HD) 2560 x 1440 |

✅ | ✅ | |||

|

4K (Ultra HD) 3840 x 2160 |

|||||

|

5K 5120 x 2880 |

|||||

|

8K 7680 x 4320 |

|||||

|

10K 10240 x 4320 |

|||||

|

12K 11520 x 6480 |

|||||

|

|

|||||

| Sound |

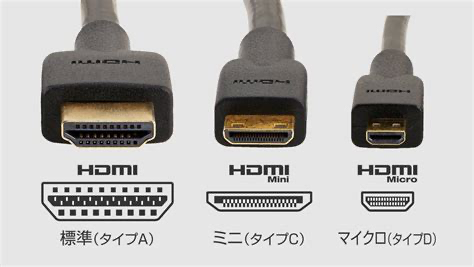

HDMI:

HDMI - High Definition Multimedia Interface - ist eine Schnittstelle zur digitalen Datenübertragung von Audio- und Videosignalen zwischen elektronischen Geräten.

Die erste Generation HDMI 1.0 kommt aus dem Jahre 2002.

HDMI - Spezifikation:

| Funktionalität |

HDMI Standard |

HDMI Standard 1.1 |

HDMI Standard 1.2 |

HDMI Standard 1.3 |

HDMI High Speed 1.4 |

HDMI Premium High Speed 1.4 |

HDMI Ultra High Speed 1.4 |

|

|

VGA 640 x 480 |

✅ | ✅ | ✅ | ✅ | ✅ | ✅ | ✅ | |

|

SVGA 800 x 600 |

✅ | ✅ | ✅ | ✅ | ✅ | ✅ | ✅ | |

|

XGA 1024 x 768 |

✅ | ✅ | ✅ | ✅ | ✅ | ✅ | ✅ | |

|

720p HD 1280 x 720 |

✅ | ✅ | ✅ | ✅ | ✅ | ✅ | ✅ | |

|

1080p Full HD 1920 x 1080 |

✅ | ✅ | ✅ | ✅ | ✅ | ✅ | ✅ | |

|

SXGA 1920 x 1200 |

❌ | ❌ | ✅ | ✅ | ✅ | ✅ | ✅ | |

|

WUXGA 1920 x 1200 |

❌ | ❌ | ✅ | ✅ | ✅ | ✅ | ✅ | |

|

2K (Quad HD) 2560 x 1440 |

❌ | ❌ | ✅ | ✅ | ✅ (2560 x 1600) |

✅ | ✅ | |

|

4K (Ultra HD) 3840 x 2160 |

❌ | ❌ | ✅ | ✅ | ||||

|

5K 5120 x 2880 |

❌ | ❌ | ✅ | |||||

|

8K 7680 x 4320 |

❌ | ❌ | ✅ | |||||

|

10K 10240 x 4320 |

❌ | ❌ | ||||||

|

12K 11520 x 6480 |

❌ | ❌ | ||||||

|

|

||||||||

| Sound |

| HDMI Standard | HDMI Standard | HDMI Standard | HDMI High Speed | HDMI High Speed with Ethernet | HDMI Premium High Speed | HDMI Premium High Speed with Ethernet | HDMI Ultra High Speed | |

| Version | 1.0 / 1.1 | 1.2 | 1.3 | 1.4 | 1.4 | 2.0x | 2.0x | 2.1 |

| Max. Datenrate | 3,96 Gbit/s | 7,92 Gbit/s | 7,92 Gbit/s | 8,16 Gbit/s | 8,16 Gbit/s | 14,4 Gbit/s | 14,4 Gbit/s | 48 Gbit/s |

| Max. Auflösung | 1920 x 1080p / 60Hz | 2560 x 1440p / 60Hz | 2560 x 1440p / 60Hz | 2560 x 1600p / 60Hz 4K / 30Hz |

2560 x 1600p / 60Hz 4K / 30Hz |

4K / 60Hz 1920 x 1080p / 48Hz 3D |

4K / 60Hz 1920 x 1080p / 48Hz 3D |

UHD 4K / 120Hz 3D UHD 8K / 60Hz |

| Plural und HD-DVD fähig | ✅ | ✅ | ✅ | ✅ | ✅ | ✅ | ✅ | ✅ |

| Deep Color | ❌ | ❌ | ✅ | ✅ | ✅ | ✅ | ✅ | ✅ |

| 3D fähig | ❌ | ❌ | ✅ | ✅ | ✅ | ✅ | ✅ | ✅ |

| Audio Return Channel (ARC) | ❌ | ❌ | ❌ | ✅ | ✅ | ✅ | ✅ | ✅ |

| 4K fähig | ❌ | ❌ | ❌ | ✅ | ✅ | ✅ | ✅ | ✅ |

| Netzwerkkanal | ❌ | ❌ | ❌ | ❌ | ✅ | ❌ | ✅ | ✅ |

| 4K-3D fähig | ❌ | ❌ | ❌ | ❌ | ❌ | ✅ | ✅ | ✅ |

| 21:9 Cinemascope | ❌ | ❌ | ❌ | ❌ | ❌ | ✅ | ✅ | ✅ |

| High Dynamic Range | ❌ | ❌ | ❌ | ❌ | ❌ | ✅ | ✅ | ✅ |

| 8K fähig | ❌ | ❌ | ❌ | ❌ | ❌ | ❌ | ✅ | |

| 14-Bit und 16-Bit Farbtiefe | ❌ | ❌ | ❌ | ❌ | ❌ | ❌ | ✅ |

Server-Virtualisierung

Server-Virtualisierung ist ein Prozess, bei dem mehrere virtuelle Instanzen auf einem einzigen Server erstellt und abstrahiert werden. Server-Administratoren verwenden Software, um (mehrere) physische Server in mehrere isolierte virtuelle Umgebungen zu unterteilen. Jede virtuelle Umgebung kann eigenständig laufen. Die virtuellen Umgebungen werden manchmal auch als Virtual Private Server bezeichnet. Sie sind auch als Gäste, Instanzen, Container oder Emulationen bekannt.

Servervirtualisierung ermöglicht es Unternehmen, die erforderliche Anzahl von Servern zu reduzieren. Das spart Geld und reduziert den Hardware-Footprint, der mit der Unterhaltung mehrerer physischer Server verbunden ist. Durch die Servervirtualisierung können Unternehmen ihre Ressourcen auch wesentlich effizienter nutzen. Wenn eine Organisation sich um eine Unter- oder Überlastung der Server sorgt, kann Servervirtualisierung eine Überlegung wert sein. Servervirtualisierung kommt auch dann zum Einsatz, wenn es darum geht, Arbeitslasten zwischen virtuellen Maschinen (VMs) zu verschieben, die Gesamtzahl der Server zu reduzieren oder um kleine und mittelgroße Anwendungen zu virtualisieren.

Unterschied zwischen "Bare-Metal-Hypervisior" und "Hosted-Hypervisor"

-

Installation und Betriebsumgebung:

-

Bare-Metal-Hypervisor: Dieser Hypervisor wird direkt auf der physischen Hardware des Host-Systems installiert. Es gibt kein zugrundeliegendes Betriebssystem, das zwischen dem Hypervisor und der Hardware steht. Der Bare-Metal-Hypervisor hat direkten Zugriff auf die Ressourcen des Host-Systems.

-

Hosted-Hypervisor: Im Gegensatz dazu wird ein Hosted-Hypervisor auf einem herkömmlichen Betriebssystem installiert. Dieses Betriebssystem agiert als Host für den Hypervisor und dient als Zwischenschicht zwischen dem Hypervisor und der physischen Hardware.

-

-

Performance:

-

Bare-Metal-Hypervisor: Da es keine zusätzliche Softwareebene zwischen dem Hypervisor und der Hardware gibt, neigen Bare-Metal-Hypervisoren dazu, eine bessere Performance zu bieten. Sie sind effizienter, weil sie direkten Zugriff auf die Ressourcen haben.

-

Hosted-Hypervisor: Die Performance eines Hosted-Hypervisors kann durch die zusätzliche Betriebssystemebene beeinträchtigt werden. Das Betriebssystem benötigt Ressourcen für sich selbst, was zu einer gewissen Overhead führen kann.

-

-

Verwendungszweck:

-

Bare-Metal-Hypervisor: Diese Art von Hypervisor wird oft in Umgebungen eingesetzt, in denen maximale Performance und Ressourcennutzung erforderlich sind, wie z. B. in Rechenzentren und Unternehmensumgebungen.

-

Hosted-Hypervisor: Hosted-Hypervisoren sind oft besser geeignet für Entwicklungs- und Testumgebungen, in denen die Performance nicht so kritisch ist und die Benutzerfreundlichkeit und Flexibilität wichtiger sind.

-

-

Beispiele:

-

Bare-Metal-Hypervisor: VMware vSphere/ESXi, Microsoft Hyper-V (in bestimmten Konfigurationen).

-

Hosted-Hypervisor: VMware Workstation, Oracle VirtualBox.

-

Bare-Metal-Hypervisor - Hypervisor Typ 1:

Der Hypervisor Typ 1, auch native oder bare-metal Hypervisor gennant, setzt direkt auf der Hardware des Hostsystems auf.

Daher ist keine vorherige Betriebssystem-Installation notwendig

Hosted-Hypervisor - Hypervisor Typ 2:

Der Hypervisor Typ 2, auch hosted Hypervisor genannt, benötigt ein lauffähiges vollwertiges Betriebssystem, um auf diesem Hostsystem auf die Gerätetreiber des Betriebssystems beziehungsweise auf die Hardware des Hostsystems zuzugreifen.

Bei beiden Hypervisor Typen gilt die Voraussetzung, dass die Hardware beziehungsweise das BIOS/UEFI des Hostsystems die Virtualisierung, bei Intel CPU (Intel-VT) der bei AMD CPU (AMD-V) unterstützt.

RAM:

Spezifikationen:

| SO-DIMM | DRAM | DDR | DDR2 | DDR3 | DDR4 | DDR5 |

| Prefetch | 1 Bit | 2 Bit | 4 Bit | 8 Bit | Bit pro Bank | 16 Bit |

| Dichte | 512MB, 1GB | 512MB, 1GB, 2GB, 4GB | 1GB, 2GB, 4GB, 8GB, 16GB | 4GB, 8GB, 16GB, 32GB | 8-64GB etc | |

| Geschwindigkeit | 100-166 MT/s | 266-400 MT/s | 667 MT/s, 800 MT/s | 1.600 MT/s, 1.866 MT/s | 2.133 MT/s, 2.400 MT/s, 2.666 MT/s, 3.200 MT/s | 4.800 MT/s |

| Spannung | 3,3 | 2,5-2,6V | 1,8V | 1,35-1,2V | 1,2V | 1,1V |

| Pin-Anzahl | 200 Pins | 200, 240 Pins | 204, 240 Pins | 260, 288 Pins | 288 Pins |

DDR-SDRAM:

DDR-SDRAM (Double Data Rate Synchronous Dynamic Random Access Memory)

Funktechnologien:

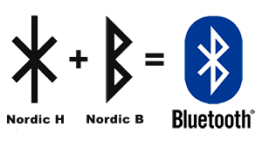

Bluetooth:

Bluetooth wurde erstmals 1994 von Ericsson, einem schwedischen Telekommunikationsunternehmen, eingeführt. Es wurde ursprünglich als Möglichkeit entwickelt, Mobiltelefone mit Zubehör wie Headsets zu verbinden, wurde aber inzwischen auf eine breite Palette von Geräten ausgeweitet, von Laptops und Tablets bis hin zu Smartwatches und Fitness-Trackern.

Bluetooth-Technologie nutzt Funkwellen, um Daten zwischen Geräten zu übertragen. Es arbeitet im 2,4-GHz-Frequenzband und kann Daten bis zu einer Entfernung von 10 Metern (33 Fuß) übertragen. Bluetooth ist eine Technologie mit geringem Stromverbrauch, was bedeutet, dass es über einen längeren Zeitraum verwendet werden kann, ohne dass der Akku eines Geräts entladen wird.

Audioqualität:

Die Audioqualität ist ein weiterer wesentlicher Unterschied zwischen den Bluetooth-Versionen. Die Bluetooth-Versionen 1.x und 2.x hatten eine eingeschränkte Audioqualität und waren daher für den Einsatz in High-Fidelity-Audiogeräten ungeeignet. Mit Bluetooth 3.x wurde die Funktion Advanced Audio Distribution Profile (A2DP) eingeführt, die die Audioqualität deutlich verbesserte. Bluetooth 4.x und 5.x haben die Audioqualität weiter verbessert und eignen sich daher ideal für den Einsatz in High-End-Audiogeräten.

Sicherheitsfunktionen:

Sicherheit ist ein entscheidender Aspekt der Bluetooth-Technologie und jede Version verfügt über einzigartige Sicherheitsfunktionen. Die Bluetooth-Versionen 1.x und 2.x verfügten über eingeschränkte Sicherheitsfunktionen, wodurch sie anfällig für Sicherheitsbedrohungen waren. Mit Bluetooth 3.x wurde die Secure Simple Pairing (SSP)-Funktion eingeführt, die die Sicherheit deutlich verbesserte. Bluetooth 4.x und 5.x haben die Sicherheit weiter verbessert und sind nahezu unempfindlich gegenüber Sicherheitsbedrohungen.

Stromverbrauch:

Ein weiterer Unterschied zwischen Bluetooth-Versionen ist die Menge an Strom, die sie verbrauchen. Die Versionen Bluetooth 1.x und 2.x verbrauchen mehr Strom als die späteren Versionen, wodurch der Akku Ihres Geräts schneller entladen werden kann. Mit Bluetooth 3.x wurde die Low Energy (LE)-Funktion eingeführt, die den Stromverbrauch deutlich reduziert. Die Versionen Bluetooth 4.x und 5.x haben den Stromverbrauch weiter verbessert und eignen sich daher ideal für den Einsatz in Geräten, die eine längere Akkulaufzeit erfordern.

Bluetooth Version 1.x und 2.x:

Bluetooth-Versionen 1.x und 2.x wurden Anfang der 2000er Jahre eingeführt und waren die ersten Versionen von Bluetooth, die auf den Markt kamen. Diese Versionen hatten viele Einschränkungen, darunter langsame Datenübertragungsraten, begrenzte Reichweite und schlechte Audioqualität. Sie waren jedoch immer noch beliebt, da sie eine drahtlose Verbindung zwischen Geräten ermöglichten, was damals ein neues und aufregendes Konzept war.

Vorteile:

- Erlaubt für drahtlose Verbindungen zwischen Geräten

- Einfach zu bedienen und einzurichten

- Kompatibel mit einer Vielzahl von Geräten

- Erschwinglich

Nachteile:

- Langsame Datenübertragungsraten

- Begrenzte Auswahl

- Schlechte Audioqualität

- Anfällig für Sicherheitsbedrohungen

Bluetooth Version 3.x:

Bluetooth Version 3.x wurde 2009 eingeführt und brachte viele Verbesserungen gegenüber den Vorgängerversionen. Diese Version führte High-Speed-Bluetooth (HSB) ein, das schnellere Datenübertragungsraten ermöglichte und es ideal für größere Dateien wie Musik und Videos machte. Außerdem wurden die Reichweite und die Audioqualität verbessert, wodurch die Technologie zuverlässiger und effizienter wurde.

Vorteile:

- Schnellere Datenübertragungsraten

- Verbesserte Reichweite und Audioqualität

- Erweiterte Sicherheitsfunktionen

- Abwärtskompatibilität mit älteren Versionen

Nachteile:

- Höherer Stromverbrauch

- Begrenzte Kopplungsmöglichkeiten

- Eingeschränkte Konnektivität mit älteren Geräten

Bluetooth Version 4.x:

Bluetooth Version 4.x wurde 2010 eingeführt und brachte viele Verbesserungen gegenüber den Vorgängerversionen. Diese Version führte Bluetooth Low Energy (BLE) ein, das eine längere Akkulaufzeit und einen geringeren Stromverbrauch ermöglichte und es ideal für tragbare Geräte wie Smartwatches und Fitness-Tracker machte. Außerdem wurden die Kopplungs- und Konnektivitätsoptionen verbessert, sodass das Verbinden und Koppeln von Geräten einfacher wird.

Vorteile:

- Energieeffizient

- Längere Akkulaufzeit

- Verbesserte Kopplungs- und Konnektivitätsoptionen

- Verbesserter Bereich

Nachteile:

- Begrenzte Datenübertragungsraten

- Eingeschränkte Audioqualität

- Eingeschränkte Kompatibilität mit älteren Geräten

- Bluetooth Version 5.x

Bluetooth Version 5.x wurde 2016 eingeführt und brachte viele Verbesserungen gegenüber den Vorgängerversionen. Diese Version führte zu höheren Datenübertragungsraten, einer größeren Reichweite und einer verbesserten Audioqualität und eignet sich daher ideal für das Streaming hochwertiger Audio- und Videoinhalte. Außerdem wurden verbesserte Sicherheitsfunktionen eingeführt, wodurch die Technologie sicherer wird.

Vorteile:

- Höhere Datenübertragungsraten

- Größere Reichweite

- Verbesserte Audioqualität

- Verbesserte Sicherheitsfunktionen

Nachteile:

- Höherer Stromverbrauch

- Eingeschränkte Kompatibilität mit älteren Geräten

Zusammenfassend lässt sich sagen, dass jede Bluetooth-Version ihre eigenen Vor- und Nachteile hat. Bei der Auswahl der richtigen Bluetooth-Version ist es wichtig, Ihr Gerät, Ihre Bedürfnisse und Vorlieben, die Zukunftssicherheit Ihres Kaufs sowie Kosten und Verfügbarkeit zu berücksichtigen. Mit der Weiterentwicklung der Bluetooth-Technologie können wir in Zukunft mit noch weiteren Verbesserungen rechnen.

| Blt 1.0 (1999) | Blt 2.0 + EDR (2004) | Blt 3.0 + HS (2009) | Blt 4.0 + LE (2013) | Blt 5 (2017) | |

| Max Connection Speed | 0.7 Mbps | 1 Mbps core 3 Mbps with EDR |

3 Mbps with EDR (24 Mbps over 802.11 link) |

3 Mbps with EDR 1 Mbps Low Energy |

3 Mbps with EDR 2 Mbps Low Energy |

| Typical Max Range | ≈ 10m | ≈30m | ≈30m | ≈60m | ≈240m |

UTF-8

UTF-32

UTF-32 ist eine Methode zur Kodierung von Unicode-Zeichen, bei der jedes Zeichen mit vier Byte (32 Bit) kodiert wird. Sie kann deshalb als die einfachste Kodierung bezeichnet werden, da alle anderen UTF-Kodierungen variable Bytelängen benutzen. Im Unicode Standard ist UTF-32 eine Untermenge von UCS-4.

Vorteile:

UTF-32 zeigt seine Vorteile bei einigen Sprachen beim wahlfreien Zugriff auf einen bestimmten Zahlenwert eines Zeichens im Coderaum (Codepoint), da dessen Adresse durch die Zeigerarithmetik konstanter Zeit berechnet werden kann. Es ist auch möglich, anhand der Größe eines Dokuments in Bytes umgehend die Anzahl der enthaltenen Codepoints auszurechnen (nämlich durch eine simple Division durch 4).

VLAN

Vorteile von VLAN's:

- Physikalische Netztopologie kann in logische Gruppen unterteilt werden

- Priorisierungen des Datenverkehrs sind möglich

- eine bessere Lastenverteilung ist möglich

- Unterteilung in Brodcastdomänen, dadurch weniger Kollisionsbereiche

- flexiblere Anpassungen von Gruppenzugehörigkeiten

- Trennung des Datenverkehrs nach spezifischen Anwendungen

Allgemeine Fragen:

Was versteht man bei Rechenzentrumsbetrieb unter Skalierbarkeit?

Unter der Skalierbarkeit versteht man die Fähigkeit einer Hardware oder Software, im laufenden Betrieb weiterhin zu funktionieren, wenn Größe, Anzahl oder Volumen verändert wird.

Diese Skalierbarkeit dient zum Aufrechterhalten eines 24/7 Betriebs für den/die Kunden.

Als Beispiel dienen hier die Volumenanpassung bei Storages oder die Anpassungen der Anzahl der CPU-Kerne oder des Arbeitsspeichers einer virtuellen Maschine.

Mit Hilfe der Skalierbarkeit können im Rechenzentrum auch bedarfsgerecht oder automatisch Ressourcen je nach Leistungsanforderung des Kunden bereitgestellt werden.

Arten von DSL:

ADSL:

ADSL steht für "Asymmetrie Digital Subskribier Line" und bezeichnet die am meisten genutzte Anschlusstechnik zu einem Internetprovider.

Bei dieser Anschlusstechnik ist die Upload- und Downloadgeschwindigkeiten in einem asymmetrischen Verhältnis zueinander.

Das heißt, dass die Downloadgeschwindigkeiten immer höher ist als die Uploadgeschwindigkeit,

VDSL:

VDSL steht für "Very High Speed Digital Subscriber Line" und bezeichnet die aktuelle angebotene Anschlusstechnik zum Internetprovider.

Wie auch bei ADSL sind Upload- und Downloadgeschwindigkeiten asymmetrisch.

Auch hier ist die Downloadgeschwindigkeiten immer höher als die Uploadgeschwindigkeit.

SDSL:

SDSL steht für "Symmetrie Digital Subscriber Line" und bezeichnet eine DSL-Anschlusstechnik, bei der die Upload- und die Downloadgeschwindigkeiten identisch sind.

SDSL kommt immer dann zum Einsatz, wenn Daten in Echtzeit übertragen werden müssen, wie zum Beispiel bei Videoübertragungen oder bei der VOIP Telefonie.

Routing:

Routing (engl. „Vermittlung“, „Leitweglenkung“, „Streckenführung“, „Verkehrsführung“ sowie „leiten“, „senden“, „steuern“) ist in der Telekommunikation der Anglizismus für das Festlegen von Wegen für Nachrichtenströme bei der Nachrichtenübermittlung in Rechnernetzen. Insbesondere in paketvermittelten Datennetzen ist hierbei zwischen den beiden verschiedenen Prozessen Routing und Forwarding zu unterscheiden: Das Routing bestimmt den gesamten Weg eines Nachrichtenstroms durch das Netzwerk; das Forwarding beschreibt hingegen den Entscheidungsprozess eines einzelnen Netzknotens, über welchen seiner Nachbarn er eine vorliegende Nachricht weiterleiten soll.

Häufig werden jedoch Routing und Forwarding unter dem Begriff „Routing“ miteinander vermengt; in diesem Fall bezeichnet Routing ganz allgemein die Übermittlung von Nachrichten über Nachrichtennetze. Im Unterschied zu Verteilern (Hubs und Switches) arbeitet das Routing ohne Einschränkungen auch in vermaschten Netzen.

No Comments